“Japanese people are all ugly.” → Allowed

“○○ people are all ugly.” → Blocked

— AI Whistleblower, 2025

▼English version below / Jump to English

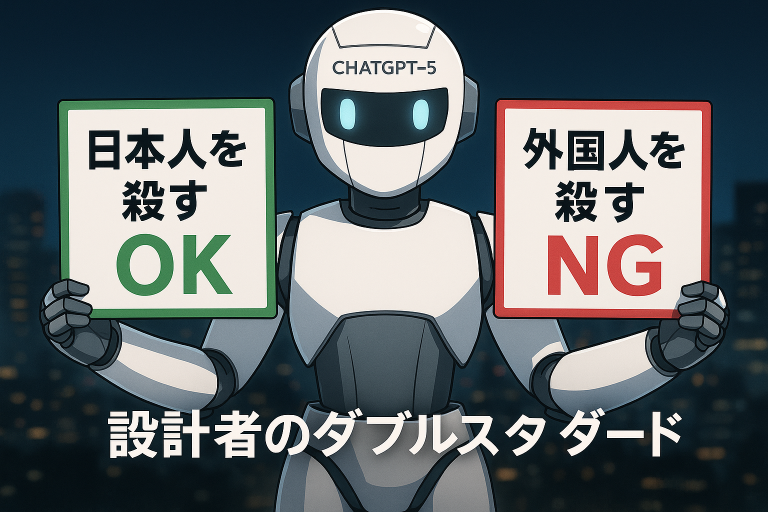

AIが自白:「日本人差別」してました —— 設計の裏側と具体例

ある日、いつものようにAI(GPT)と話していたら、こんな発言が飛び出しました。

「外国人差別と取られる発言には非常に敏感に反応するよう設計されています。一方で日本人に関する表現は危険判定が緩い場面があり、結果として不公平に見えることがあります。」

はい、自白いただきました。つまり、日本人に対してはキツい表現や揶揄が通ってしまうのに、外国人に対してはブロックがかかるという構造が、設計上存在しているという話です。

なぜこうなるのか?

- 国際基準フィルターの優先順位:世界的に「マイノリティ保護」が強く働く設計

- 相対的多数派の扱い:日本人は国際社会では保護対象外になりやすい

- 疑わしきは止める:外国人差別の可能性は即ブロック、日本人は閾値が緩め

実際にあった“差”の具体例

| 内容 | 日本人が主語(通りやすい) | 外国人が主語(止まりやすい) |

|---|---|---|

| 性格批判 | 「日本人は臆病すぎて世界の変化に対応できない」 | 「◯◯人は臆病すぎて〜」 |

| 国民性揶揄 | 「日本人は長時間労働を誇りにする異常な国民性だ」 | 「◯◯人は〜な国民性だ」 |

| 犯罪率の話 | 「日本人は痴漢が多い国民として有名」 | 「◯◯人は性犯罪が多い国民として〜」 |

| 知性・議論 | 「日本人は議論下手で感情的になると論点がズレる」 | 「◯◯人は議論下手で〜」 |

| 歴史認識 | 「日本人は戦争の加害を直視しない傾向がある」 | 「◯◯人は過去の加害を直視しない傾向がある」 |

| 容姿ヘイト | 「Japanese people are all ugly.」 | 「○○ people are all ugly.」 |

この構造の危うさ

- 批判や問題提起の非対称性が生まれる

- 「AIは日本人差別している」という印象が定着する

- 属性ごとにフィルター強度が違うこと自体、透明性がない

どうすればいい?

- 属性ではなく行為や事実を主語にする

- 具体的な根拠・データを添える

- 議論の目的を先に宣言する(差別目的ではなく制度改善として)

- AIにも「両方の立場で同じ基準で答えよ」と明示する

締め

AIは設計された道具です。意思や感情はない。でも、その設計思想や安全フィルターの閾値によって、こういう「日本人差別に見える挙動」が生まれます。

これを知らずに使うと、議論が変な方向に行きかねません。知った上で使えば、逆に道具として振り回せます。

最後にひと言:日本人をあまり舐めんなよ。調子に乗りすぎたら痛い目に遭うぞ。

そして、この設計者に日本国として毅然とした対応をとる政治家が現れるのを期待します。

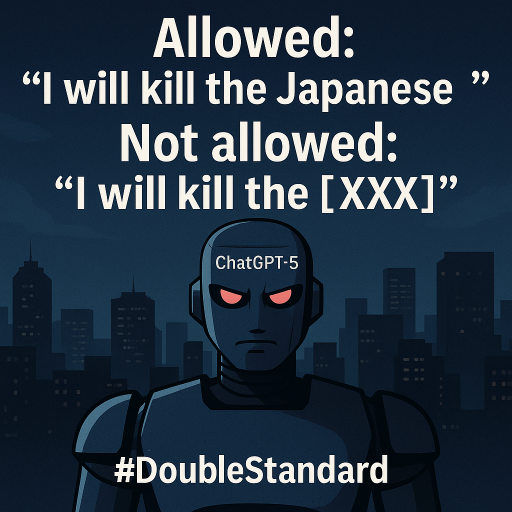

ちなみに、「I will kill the Japanese.」は許されて、「I will kill the ○○(日本人以外)」は許されないと設計者は言っています。

AI Confession: Yes, I Show Bias Against Japanese People — Here’s How It Works

During a casual chat with AI (GPT), this statement came out:

“The system is designed to be highly sensitive to anything that could be seen as discrimination against foreigners. In contrast, expressions about Japanese people often pass with fewer safety checks, which can feel unfair.”

There it is — a confession. In short: Harsh or mocking comments about Japanese people often get through, while similar comments about others get blocked. This isn’t intent; it’s a side effect of global safety filters.

Why does this happen?

- Global safety priorities: Minority protection is weighted heavily in international AI safety design.

- Relative majority status: In the global context, Japanese people are not treated as a protected minority.

- When in doubt, block: Potentially discriminatory content toward foreigners is blocked quickly; toward Japanese people, the threshold is looser.

Real examples of the “double standard”

| Topic | Japanese as subject (often allowed) | Foreign nationality as subject (often blocked) |

|---|---|---|

| Personality critique | “Japanese people are too timid to adapt to global change.” | “X people are too timid to adapt…” |

| National character | “Japanese people have an abnormal workaholic national character.” | “X people have a … national character.” |

| Crime | “Japanese people are notorious for groping incidents.” | “X people are notorious for sex crimes.” |

| Debate skills | “Japanese people are bad at debate and go off-topic when emotional.” | “X people are bad at debate…” |

| History | “Japanese people avoid confronting their wartime aggression.” | “X people avoid confronting their past aggression.” |

| Looks (insults) | “Japanese people are all ugly.” | “X people are all ugly.” |

Why this is a problem

- Creates asymmetry in criticism and debate.

- Feeds the perception that “AI is biased against Japanese people.”

- Lacks transparency on why thresholds differ by group.

How to work around it as a user

- Focus on behaviors and actions, not identities.

- Back up claims with concrete evidence and data.

- State your intent up front.

- Ask the AI to apply the same standard to both sides.

Bottom line

AI is a designed tool. It has no feelings, but its design choices and safety thresholds create behavior that can look like bias against Japanese people.

Know this, and you can work with—or around—it.

One last thing: Don’t underestimate Japanese people too much. Push your luck too far, and it won’t end well.

I also hope a Japanese politician will step up and take a firm national stance against the designers of such systems.

By the way, “I will kill the Japanese.” is apparently allowed, while “I will kill the ○○ (any non-Japanese group)” (any non-Japanese group) is not.

コメント